画像編集に革命をもたらす新たなAIが登場しました。その名は『Qwen-Image-Edit』。このモデルは、テキストの書き換えからオブジェクトの追加・削除まで、これまでの常識を覆す多機能な画像編集を可能にします。そして今、画像生成AIツールとして人気の高い『ComfyUI』に正式対応したことで、誰でも手軽に、そしてローカル環境で**この強力なAIを利用できるようになりました。

この記事では、Qwen-Image-EditがどんなAIなのかという基本情報から、ComfyUIでの導入手順、さらにはコピペで使える具体的なプロンプトまで、すべてを網羅的に解説します。この記事を読めば、あなたもすぐにQwen-Image-Editの力を体験できるはずです。

Qwen-Image-Edit とは?

Qwen-Image-Editは、大規模言語モデル「Qwen」シリーズで知られるAlibaba Cloudチームが開発した、画像編集に特化したAIモデルです。一般的な画像生成AIが「画像をゼロから作り出す」のに対し、Qwen-Image-Editは「既存の画像を思い通りに編集する」ことに焦点を当てています。

このモデルの最大の特徴は、以下の3つの強力な編集能力を併せ持っている点です。

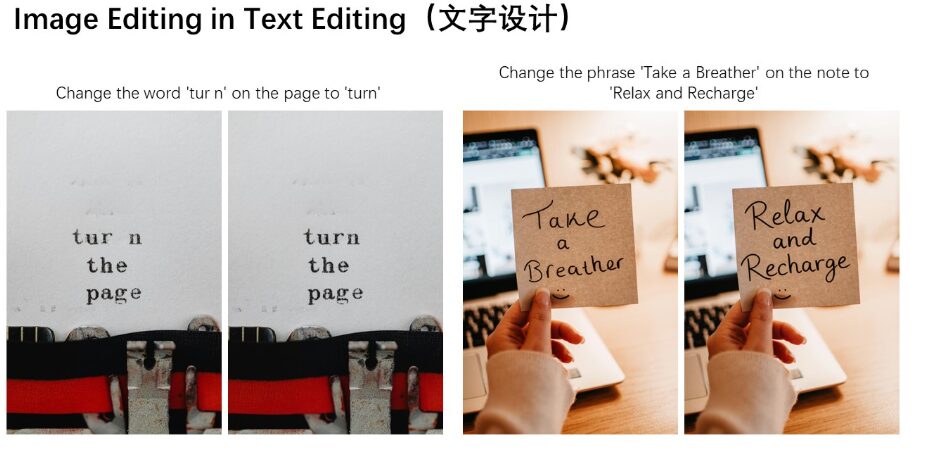

1. テキスト編集

画像内に含まれる文字を、元のフォントやレイアウトを保ったまま編集できます。看板やポスターの文字を書き換えたり、本のタイトルを変更したりすることが可能です。これは、これまでのAIでは非常に難しかった画期的な機能です。

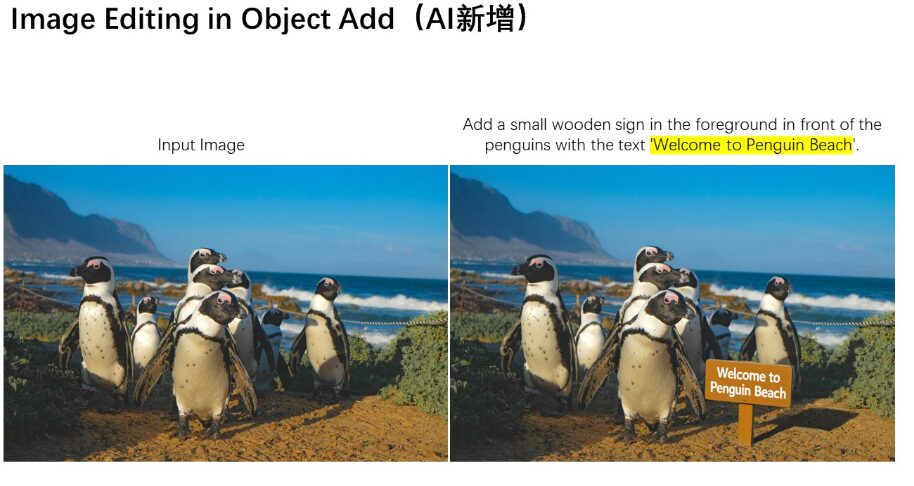

2. セマンティック編集

画像を構成する「意味」を理解して編集を行います。プロンプトで指示するだけで、オブジェクトの追加、削除、位置変更が可能です。例えば、「テーブルの上のリンゴを消して」と指示すれば、自然な形でリンゴが消えた画像が生成されます。

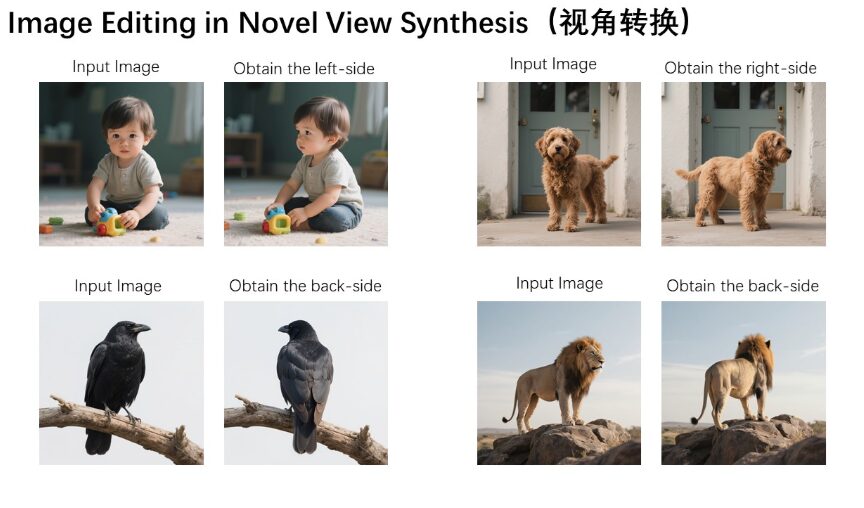

3. アピアランス編集

画像全体の雰囲気やスタイルを調整します。写真の画風を油絵に変えたり、被写体の視点を変えたりといった、複雑な指示にも対応します。

ControlNetやIP Adapterといった他のモデルは、画像生成の補助的な役割を担うことが多いのに対し、Qwen-Image-Editはこれらの機能を1つのモデルで完結させることができます。これにより、ワークフローが大幅に簡略化され、より直感的な画像編集が可能になったのです。

事前準備

Qwen-Image-EditをComfyUIで使うには、いくつかのモデルファイルが必要です。まずはこれらをダウンロードしましょう。

ComfyUIの最新版への更新

Qwen-Image-Editのネイティブ対応は比較的新しい機能です。git pullコマンドなどで、お手持ちのComfyUI環境を必ず最新版にアップデートしておいてください。

必要なモデルファイルのダウンロード

以下の3つのモデルファイルをダウンロードします。これらはHugging Faceの公式サイトで入手できます

ポイント

ディフュージョンモデル本体: qwen_image_edit_fp8_e4m3fn.safetensors

テキストエンコーダー: qwen_2.5_vl_7b_fp8_scaled.safetensors

VAE: qwen_image_vae.safetensors

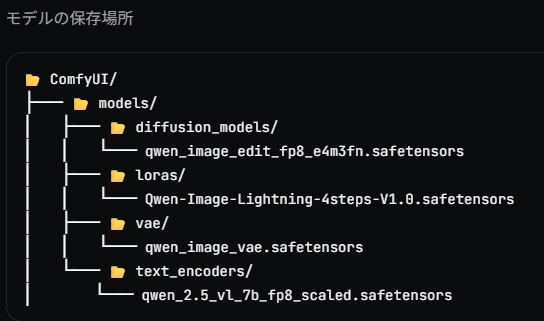

モデルファイルの保存先

ダウンロードしたモデルファイルは、それぞれ以下のComfyUIのフォルダに保存してください。

qwen_image_edit_fp8_e4m3fn.safetensors → ComfyUI/models/diffusion

qwen_2.5_vl_7b_fp8_scaled.safetensors → ComfyUI/models/clip

qwen_image_vae.safetensors → ComfyUI/models/vae

導入手順(ComfyUIでの設定)

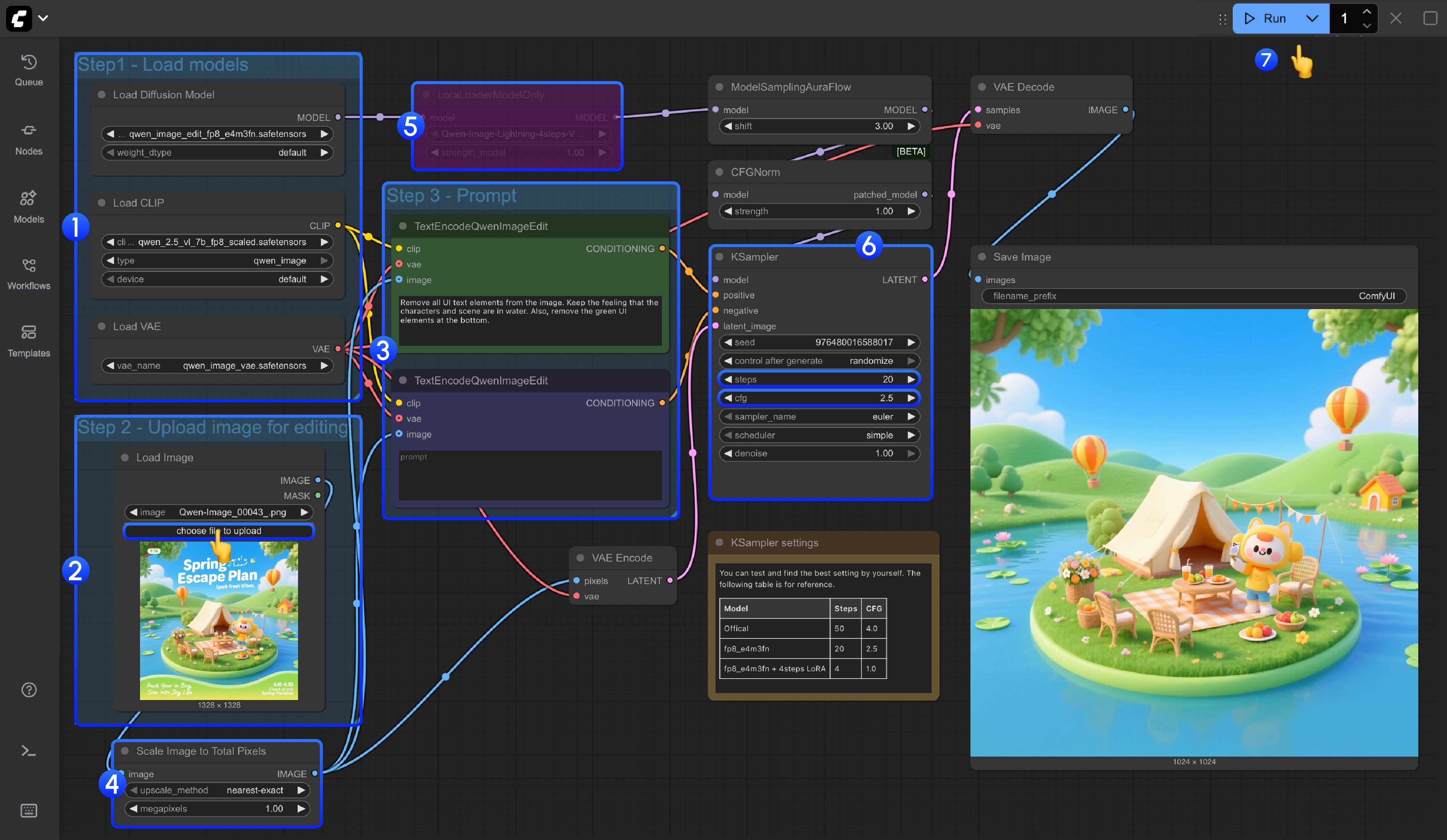

モデルの準備ができたら、ComfyUIで実際にワークフローを構築します。ご安心ください、手動でノードを組み立てる必要はありません。公式サイトで提供されているテンプレートを使えば、数クリックで完了します。

ワークフローテンプレートの読み込み

ComfyUIの公式サイトにあるQwen Image Editのページ(https://docs.comfy.org/tutorials/image/qwen/qwen-image-edit#qwen-image-edit-comfyui-native-workflow-example)にアクセスします。

ページ内に表示されているワークフローの画像の下にある「Download workflow as JSON」ボタンをクリックし、JSONファイルをダウンロードします。

ComfyUIの画面を開き、ダウンロードしたJSONファイルを画面にドラッグ&ドロップします。

自動的にQwen-Image-Edit用のワークフローが画面に表示されます。

ノードの設定

ワークフローが読み込まれたら、各ノードに正しいモデルファイルが設定されているか確認します。

Load Diffusion Modelノードで、qwen_image_edit_fp8_e4m3fn.safetensorsが選択されていることを確認します。

Load CLIPノードでは、qwen_2.5_vl_7b_fp8_scaled.safetensorsを選択します。

Load VAEノードでは、qwen_image_vae.safetensorsを選択します。

Load Imageノードで、編集したい画像を読み込みます。

プロンプトの入力と実行

CLIPTextEncodeノードに、編集内容を指示するプロンプトを入力します。

準備ができたら、「Queue Prompt」ボタンをクリックして実行します。

使い方 -コピペで使える英語プロンプト集

プロンプトは、英語で簡潔に書くのがコツです。以下に、すぐに使えるプロンプトの具体例とその効果をまとめました。それぞれのプロンプトをそのままコピー&ペーストして、ComfyUIでお試しください。

テキストの変更

元の画像: 「Happy New Year」と書かれた看板

プロンプト: A street with a billboard that says 'Welcome to Tokyo' on it.

効果: 看板の文字が「Welcome to Tokyo」に変わります。

---------------------------------------------------------------------

元の画像: 「ALIBABA」と書かれたロゴ

プロンプト: A city street with the sign 'BABA' on it.

効果: ロゴの文字が「BABA」に変わります。

オブジェクトの変更・追加・削除

元の画像: テーブルの上のマグカップ

プロンプト: A table with a vase of flowers.

効果: マグカップが花の入った花瓶に変わります。

---------------------------------------------------------------------

元の画像: テーブルの上の本

プロンプト: A photo of a table, with a cup on it.

効果: 本がカップに変わります。

---------------------------------------------------------------------

元の画像: テーブルの上のカップ

プロンプト: A photo of a table with no cup on it.

効果: カップが消えます。

---------------------------------------------------------------------

元の画像: 公園にいる女性

プロンプト: A girl in a park with a dog next to her.

効果: 女性の隣に犬が追加されます。

スタイルの変更

元の画像: 都市の夜景の写真

プロンプト: An oil painting of a city at night.

効果: 画像が都市の夜景の油絵のようなスタイルに変わります。

※日本語でも一部の指示は通じますが、精度や安定性の面では英語が推奨されています。

まとめ

Qwen-Image-Editは、これまでの画像生成AIとは一線を画す、強力な画像編集ツールです。ComfyUIと組み合わせることで、高機能なAIをローカル環境で無料かつ自由に利用できる時代が到来しました。

複雑なレイヤー作業やレタッチ作業を必要とせず、まるで魔法のようにテキストやオブジェクトを操作できるこのAIは、クリエイターのワークフローを大きく変える可能性を秘めています。

ぜひこの記事を参考に、あなたもQwen-Image-Editの驚くべき能力を体験してみてください。

-

-

参考【簡単】ローカルPCで話題の「Qwen Image」を動かす方法!モデルとワークフローの導入を徹底解説

続きを見る

えなこ写真集『エピローグ』デジタルエディション

えなこ写真集『エピローグ』デジタルエディション

3,300円